Kryptographie und Schlüsselmanagement

In Cloud-Umgebungen durchlaufen Daten unsichere Netzwerke und befinden sich auf Infrastruktur, die der Kunde weder physisch kontrolliert noch vollständig einsehen kann. Die Verschlüsselung ist daher nicht optional, sondern fundamental für Cloud-Sicherheit.

Encryption in Transit

Daten, die zwischen Clients und Cloud-Services übertragen werden, passieren häufig öffentliche Netzwerke. Diese gelten grundsätzlich als nicht vertrauenswürdig und sind potenziell Abhör- sowie Man-in-the-Middle-Angriffen ausgesetzt. Transport Layer Security (TLS) schützt diese Kommunikation durch Verschlüsselung und stellt über Zertifikate die Authentizität des Servers sicher.

Führende Cloud-Provider stellen TLS-gesicherte Endpunkte für ihre Services bereit und erzwingen deren Nutzung häufig standardmäßig. Dennoch verbleibt die Verantwortung beim Kunden, eigene Anwendungen konsequent über verschlüsselte Verbindungen zu betreiben und unsichere Protokolle zu unterbinden.

Encryption at Rest

Verschlüsselung im Ruhezustand schützt Daten auf Speichermedien. Selbst wenn ein Angreifer physischen Zugriff auf Festplatten erhält, sind verschlüsselte Daten ohne die zugehörigen Schlüssel wertlos.

In mehrmandantenfähigen Cloud-Umgebungen ist dies besonders kritisch. Die physische Isolation zwischen Mandanten ist nicht gegeben – Daten verschiedener Kunden können theoretisch auf denselben physischen Speichersystemen liegen. Verschlüsselung stellt sicher, dass selbst bei Versagen der logischen Isolierung keine Daten kompromittiert werden.

Cloud-Provider bieten typischerweise zwei Verschlüsselungsoptionen: Provider-Managed Encryption, bei der der Anbieter Schlüssel generiert und verwaltet, oder Customer-Managed Keys, bei denen der Kunde vollständige Kontrolle über Schlüssel behält. Letzteres bietet stärkere Sicherheitsgarantien, da Provider verschlüsselte Daten physisch speichern kann, aber inhaltlich nicht einsehen.

Herausforderungen des Schlüsselmanagements

Die Sicherheit kryptographischer Verfahren hängt maßgeblich von der Verwaltung der verwendeten Schlüssel ab. Wird ein Schlüssel kompromittiert, können damit geschützte Daten potenziell offengelegt werden. Eine effiziente Schlüsselverwaltung umfasst daher den gesamten Lebenszyklus – von der sicheren Generierung über Speicherung und Rotation bis hin zur kontrollierten Löschung.

Hardware Security Modules (HSMs) sind physisch gehärtete Umgebungen für kryptographische Schlüssel und Operationen. Cloud-Provider bieten HSM-basierte Dienste an, die je nach Modell entweder vollständig vom Provider betrieben oder dem Kunden zur dedizierten Verwaltung überlassen werden. Dadurch können kryptografische Operationen ausgeführt werden, ohne dass das Schlüsselmaterial das geschützte HSM verlässt.

Crypto Shredding

Ein fundamentales Problem in der Cloud ist, dass Kunden keinen physischen Zugriff auf Speichermedien haben und nicht verifizieren können, ob Datenträger sicher gelöscht (mit spezialisierter Software mehrfach überschreiben) oder physisch vernichtet wurden. Traditionelle Löschmethoden wie das mehrfache Überschreiben funktionieren nicht, wenn man die Hardware nicht kontrolliert. Mit forensischen Tools können gelöschte Daten oft wiederhergestellt werden.

Crypto Shredding löst dieses Problem elegant: Die Daten werden verschlüsselt gespeichert und anstatt sie zu löschen, wird einfach der Schlüssel vernichtet. Die verschlüsselten Daten können weiterhin physisch existieren, sind ohne Schlüssel jedoch kryptographischer Müll. Diese Methode ist schnell, zuverlässig und unabhängig vom physischen Speichermedium.

Identity and Access Management

Die Zugriffskontrolle legt fest, wer auf welche Ressourcen zugreifen darf. Dies ist eine der zentralen Herausforderungen in verteilten Cloud-Umgebungen mit weltweit verteilten Nutzern, zahlreichen Services und komplexen Berechtigungsstrukturen.

Vier Arten des Zugriffs

Physischer Zugriff

In Cloud-Umgebungen liegt der physische Zugriff auf Rechenzentren und Hardware ausschließlich beim Provider. Die führenden Provider betreiben Rechenzentren mit Sicherheitsmaßnahmen auf Militärniveau inklusive Perimeterschutz, biometrischer Zugangskontrollen, 24/7-Überwachung und Sicherheitspersonal. Kunden müssen sich darauf verlassen, dass diese Maßnahmen effektiv sind, können sie jedoch nicht direkt überprüfen oder beeinflussen.

Benutzerzugriff

Beim Benutzerzugriff sind die einzelnen Personen gemeint, die mit den Cloud-Ressourcen interagieren. Jeder Cloud-Provider bietet Identity-and-Access-Management-(IAM-)Systeme wie AWS IAM, Azure Active Directory oder Google Cloud IAM. Diese definieren, welche Benutzer welche Aktionen auf welchen Ressourcen durchführen dürfen.

Das Least-Privilege-Prinzip ist fundamental. Die Benutzer erhalten nur die minimal notwendigen Berechtigungen, die sie für ihre Arbeit benötigen.

Privilegierter Zugriff

In diesem Fall sind Administratoren mit weitreichenden Berechtigungen gemeint. Diese Accounts sind besonders kritisch und erfordern zusätzlichen Schutz: Die Multi-Faktor-Authentifizierung ist Pflicht und privilegierte Aktivitäten müssen lückenlos protokolliert werden. Idealerweise nutzen Administratoren separate Accounts für administrative und normale Tätigkeiten.

Administrative Access (service access)

Selbst bei strengen organisatorischen und technischen Kontrollmechanismen besteht in Cloud-Umgebungen theoretisch die Möglichkeit, dass privilegierte Administratoren des Providers auf die zugrunde liegenden Systeme zugreifen können. Dieses Restrisiko ist ein inhärenter Bestandteil des Cloud-Betriebsmodells. Die Verschlüsselung durch den Cloud-Nutzer mit Customer-Managed Keys bietet einen wirksamen Schutz gegen diese hypothetische Gefahr.

Netzwerksicherheit in der Cloud

Cloud-Netzwerke unterscheiden sich grundlegend von traditionellen Unternehmensnetzwerken. Die Ressourcen sind global verteilt, die Workloads sind hochdynamisch und die Netzwerkperimeter verschwimmen. Eine perimeterbasierte Sicherheit, wie sie bei traditionellen Netzwerken durch eine Firewall am Rand des Netzwerks realisiert wird, funktioniert in der Cloud nicht.

Software-Defined Networking und Mikrosegmentierung

Bei Software-Defined Networking (SDN) wird die zugrunde liegende physische Netzwerkinfrastruktur abstrahiert und die Steuerungsfunktionen werden in eine zentrale, softwarebasierte Kontrollebene überführt.

SDN entkoppelt die Kontrollebene von der Datenebene. Dadurch können Routing- und Sicherheitsentscheidungen zentral in Software definiert werden, während die zugrunde liegende Infrastruktur den Datenverkehr entsprechend weiterleitet. Dieses Modell bildet die Grundlage für hochgradig virtualisierte, automatisierbare und programmierbare Cloud-Netzwerke.

Cloud-Anbieter stellen softwarebasierte Filtermechanismen bereit, wie z.B. Security Groups und Network Access Control Lists (NACLs) in AWS sowie Network Security Groups (NSGs) in Azure. Security Groups und Network Security Groups sind zustandsbehaftet (stateful) und kontrollieren den Datenverkehr auf Workload-Ebene, während NACLs zustandslos (stateless) als zusätzliche Schutzschicht auf Subnetzebene dienen. Gemeinsam ermöglichen sie eine granulare Steuerung des Netzwerkverkehrs nach dem Least-Privilege-Prinzip.

Bei der Mikrosegmentierung werden Sicherheitsrichtlinien nicht mehr nur auf Netzwerkzonen, sondern auf einzelne Workloads oder sogar spezifische Kommunikationsbeziehungen angewendet. Dadurch wird die seitliche Bewegung (lateral Movement) innerhalb eines kompromittierten Netzwerks erheblich erschwert, da jede Verbindung explizit autorisiert werden muss. Mikrosegmentierung ist daher ein zentrales Architekturprinzip moderner Zero-Trust-Modelle.

Zero Trust Network Access

Das Zero-Trust-Modell widerspricht der Annahme, dass Ressourcen innerhalb eines „vertrauenswürdigen“ Netzwerks per se vertrauenswürdig sind. Stattdessen wird jede Anfrage unabhängig von ihrer Herkunft authentifiziert, autorisiert und verschlüsselt.

In Cloud-Umgebungen ist Zero Trust von besonderer Relevanz. Benutzer greifen von verschiedenen Standorten und Geräten aus zu, Workloads kommunizieren über Provider-Grenzen hinweg und auch Partnerorganisationen benötigen selektiven Zugriff. Ein Perimeter-basiertes Schutzmodell kann diese Komplexität nicht mehr abbilden.

Bei Zero-Trust-Implementierungen kommen typischerweise Identity-basierte Zugriffskontrollen zum Einsatz. Alle Kommunikationen werden unabhängig von der Standortposition verschlüsselt und das Zugriffsverhalten wird kontinuierlich überwacht, um Anomalien zu erkennen.

VPNs und Private Links

Virtual Private Networks (VPNs) verschlüsseln Verbindungen über unsichere Netzwerke – so die Theorie. In der Praxis verbinden Site-to-Site-VPNs On-Premises-Rechenzentren mit Cloud-VPCs (Virtual Private Clouds). Client-VPNs ermöglichen Remote-Mitarbeitern wiederum den sicheren Zugriff auf Cloud-Ressourcen.

Geofencing

Als Geofencing wird die logische Beschränkung von Zugriffen oder Datenverkehr auf definierte geografische Regionen bezeichnet. Dabei wird der Zugang zu Systemen beispielsweise nur aus bestimmten Ländern, IP-Adressbereichen oder Rechenzentrumszonen zugelassen. Durch diese regionale Eingrenzung lässt sich die Angriffsfläche reduzieren und gleichzeitig die Erkennung ungewöhnlicher Aktivitäten verbessern, wenn ein Login-Versuch aus einer unerwarteten Region erfolgt. Geofencing ist besonders relevant für Organisationen mit strengen Datenschutz- oder Compliance-Anforderungen.

Virtualisierungssicherheit

Das Thema „Virtualisierungssicherheit” ist sehr komplex und umfangreich. Jeder einzelne Punkt würde ein eigenes Buch verdienen. Im Folgenden erhalten Sie daher nur einen kurzen Überblick.

Virtualisierungssicherheit

Virtualisierungssicherheit umfasst den Schutz der Hypervisor-Schicht, die mehrere virtuelle Maschinen auf gemeinsamer Hardware isoliert. In Cloud-Umgebungen werden überwiegend Typ-1-Hypervisoren eingesetzt, deren Absicherung in der Verantwortung des Providers liegt. Eine besonders kritische Bedrohung ist der sogenannte VM Escape, bei dem ein Angreifer versucht, aus einer virtuellen Maschine auszubrechen und Zugriff auf den Hypervisor oder andere Mandanten zu erlangen.

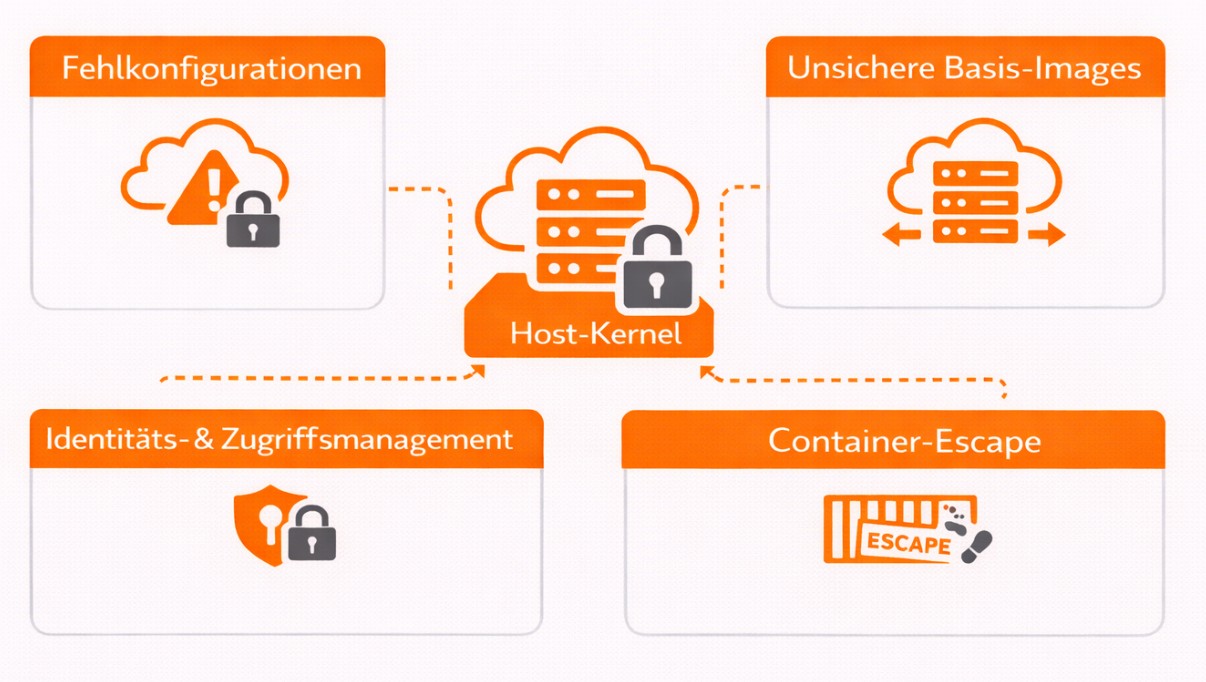

Container-Sicherheit

Die Container-Sicherheit adressiert die Risiken containerisierter Workloads, die sich einen gemeinsamen Betriebssystem-Kernel teilen. Im Vergleich zur klassischen Virtualisierung ist die Isolierung geringer. Dadurch können Fehlkonfigurationen, unsichere Basis-Images oder ein unzureichendes Identitäts- und Zugriffsmanagement zu erheblichen Sicherheitsrisiken führen. Auch Container-Escape ist eine kritische Bedrohung. Eine gehärtete Host-Umgebung sowie eine kontinuierliche Überprüfung der Container-Images sind daher von entscheidender Bedeutung.

Ephemeres Computing

Bei Ephemeres Computing werden Rechenressourcen nur für die Dauer einer Aufgabe bereitgestellt und anschließend automatisch wieder gelöscht. Diese Dynamik erhöht die Skalierbarkeit, erschwert jedoch klassische Sicherheitsmechanismen wie das Monitoring.

Serverlose Technologie (Serverless)

Bei „Serverless“ handelt es sich um ein Ausführungsmodell, bei dem der Cloud-Anbieter die gesamte Infrastruktur verwaltet und den Kunden lediglich Funktionen oder Dienste bereitstellt. Durch die reduzierte Systemtransparenz verschiebt sich der Sicherheitsfokus von der Infrastruktur auf den Anwendungscode, das Identitätsmanagement und die API-Absicherung. Besonders wichtig sind dabei restriktive Zugriffskontrollen und eine klare Begrenzung von Berechtigungen gemäß dem Least-Privilege-Prinzip.

Cloud-spezifische Bedrohungen

Cloud-spezifische Bedrohungen stellen ein vielschichtiges Themenfeld dar, das sowohl technische als auch organisatorische Risiken umfasst. Im CCSP-Kontext werden häufig drei etablierte Referenzdokumente herangezogen, die einen strukturierten, wenn auch teilweise abstrakten Überblick über typische Bedrohungsszenarien geben.

Dazu zählen

- die „Cloud Security Alliance Egregious Eleven”, die zentralen Risiken in Cloud-Umgebungen systematisieren,

- die „OWASP Cloud-Native Application Security Top 10”, die sicherheits-relevante Schwachstellen cloud-nativer Anwendungen adressieren,

- die „OWASP Top Ten”, die verbreitete Webanwendungsrisiken beschreiben, die auch in Cloud-Architekturen weiterhin relevant sind.

Cloud Security Alliance (CSA) Egregious Eleven

Der Name „Egregious Eleven” verweist auf die elf aus strategischer Perspektive besonders kritischen Bedrohungen in Cloud-Umgebungen. Im Fokus stehen Datenverlust und Datapannen, Fehlkonfigurationen sowie eine unzureichende Sicherheitsarchitektur und Governance. Weitere zentrale Risiken betreffen Schwächen im Identitäts- und Schlüsselmanagement, Kontoübernahmen, Insider-Bedrohungen sowie unsichere Schnittstellen und APIs.

Außerdem werden strukturelle Risiken wie eine schwache Control Plane, mangelnde Transparenz über die Cloud-Nutzung und der Missbrauch von Cloud-Ressourcen durch Angreifer behandelt.

Obwohl der Bericht bereits 2019 veröffentlicht wurde, sind viele der darin identifizierten Bedrohungen nach wie vor hochrelevant und spiegeln typische Schwachstellen moderner Cloud-Umgebungen wider. Einen direkten Nachfolger gibt es nicht. Zwar wurde mit „Pandemic Eleven” eine aktualisierte Bedrohungsliste veröffentlicht, diese setzt jedoch andere inhaltliche Schwerpunkte und ist somit eigenständig zu betrachten.

OWASP Cloud-Native Application Security Top 10

Die „OWASP Cloud-Native Application Security Top 10” befassen sich mit sicherheitsrelevanten Schwachstellen in cloud-nativen Architekturen. Typische Risiken sind unsichere Konfigurationen von Cloud-, Container- oder Orchestrierungsumgebungen, Injection-Schwachstellen, fehlerhafte Authentifizierung/Autorisierung sowie Schwächen in CI/CD-Pipelines und der Software-Lieferkette.

Weitere Bedrohungen betreffen die unsichere Verwaltung von Secrets, übermäßig permissive Netzwerkregeln, die Nutzung verwundbarer Komponenten, mangelndes Asset-Management sowie unzureichendes Logging und Monitoring. Dieses Dokument adressiert primär technische Implementierungsrisiken moderner Cloud-Anwendungen.

OWASP Top Ten

Die allgemeinen OWASP Top Ten beschreiben die zehn häufigsten Sicherheitsrisiken für Webanwendungen und sind auch in Cloud-Umgebungen relevant. Dazu zählen beispielsweise Broken Access Control, Security Misconfiguration, Injection-Schwachstellen, kryptographische Fehler, unsicheres Design sowie Schwächen in den Bereichen Authentifizierung, Integritätsschutz und Logging.

Basic Security Hygiene

Eine grundlegende Sicherheitshygiene bildet das Fundament jeder Cloud-Sicherheitsstrategie. Dazu gehören kontinuierliches Schwachstellen-Scanning, die Pflege aktueller Asset-Inventare und die regelmäßige Überprüfung von Konfigurationen. Nur wer weiß, welche Ressourcen existieren, kann sie wirksam schützen.

Ergänzend sind regelmäßige Penetrationstests sinnvoll, um Fehlkonfigurationen und reale Angriffswege zu identifizieren. Sie ersetzen jedoch keine kontinuierlichen Sicherheitskontrollen. Ebenso unverzichtbar sind getrennt gespeicherte und regelmäßig getestete Backups, um insbesondere bei Ransomware-Vorfällen eine Wiederherstellung zu ermöglichen.

Patching

Beim Patch-Management werden Betriebssysteme, Anwendungen und Abhängigkeiten systematisch aktualisiert, um bekannte Schwachstellen zu schließen. Da ungepatchte Systeme leicht ausnutzbar sind, werden sie häufig zum Ziel von Angriffen. Automatisierte Patch-Prozesse gelten daher als Best Practice.

Baselining

Als Baselining wird die Definition einer sicheren Standardkonfiguration bezeichnet, auf der Systeme konsistent aufgebaut werden. In Cloud-Umgebungen erfolgt dies in der Regel mittels Infrastructure as Code (IaC). Dadurch lassen sich reproduzierbare und kontrollierte Ausgangszustände schaffen sowie Configuration Drift vermeiden.

Im Sinne einer „Immutable Architecture” werden Systeme bei Updates nicht nachträglich verändert, sondern vollständig aus einer aktualisierten Baseline neu erstellt. Dieser Ansatz erhöht die Konsistenz, reduziert Fehlerquellen und vereinfacht Sicherheitsprüfungen.

Die Kombination aus Patching und Baselining ermöglicht eine robuste und wartungsfreundliche Cloud-Architektur. Anstatt Systeme zu aktualisieren, wird eine neue, sichere Baseline definiert und die bestehenden Instanzen werden durch neu bereitgestellte ersetzt. Dadurch wird die Komplexität reduziert und Konfigurationsabweichungen werden vermieden.